Зои КляйнманРедактор технологий

Зои КляйнманРедактор технологий Би-би-си

Би-би-сиГоворят, что Марк Цукерберг начал работу над ранчо Кулау, своим обширным комплексом площадью 1400 акров на гавайском острове Кауаи, еще в 2014 году.

Согласно сообщению журнала Wired, он будет включать в себя убежище с собственными запасами энергии и продуктов питания, хотя плотникам и электрикам, работающим на объекте, было запрещено говорить о нем в соответствии с соглашением о неразглашении информации.

Шестифутовая стена закрывала проект от обзора близлежащей дороги.

На вопрос в прошлом году, создавал ли он бункер Судного дня, основатель Facebook ответил категорическим «нет». Подземное пространство площадью около 5000 квадратных футов, как он объяснил, «похоже на небольшое убежище, похоже на подвал».

Это не остановило спекуляций, как и его решение купить 11 объектов недвижимости в районе Кресент-Парк в Пало-Альто в Калифорнии, по-видимому, добавив под ним подземное пространство площадью 7000 квадратных футов.

Блумберг через Getty Images

Блумберг через Getty ImagesХотя в его разрешениях на строительство упоминаются подвалы, по данным New York Times, некоторые из его соседей называют это бункером. Или пещера летучих мышей миллиардера.

Также есть спекуляции вокруг других технологических лидеров, некоторые из которых, похоже, были заняты скупкой участков земли с подземными помещениями, готовыми для превращения в роскошные бункеры стоимостью в несколько миллионов фунтов.

Рид Хоффман, соучредитель LinkedIn, говорил о «страховке от апокалипсиса». Ранее он утверждал, что это примерно половина сверхбогатых людей, поскольку Новая Зеландия является популярным местом для приобретения жилья.

Итак, могут ли они действительно готовиться к войне, последствиям изменения климата или какому-то другому катастрофическому событию, о котором остальные из нас еще не знают?

Новости Getty Images

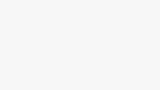

Новости Getty ImagesЗа последние несколько лет развитие искусственного интеллекта (ИИ) только добавило этот список потенциальных экзистенциальных проблем. Многие глубоко обеспокоены скоростью прогресса.

Сообщается, что Илья Суцкевер, главный научный сотрудник и соучредитель Open AI, является одним из них.

К середине 2023 года компания из Сан-Франциско выпустила ChatGPT — чат-бот, которым сейчас пользуются сотни миллионов людей по всему миру, — и они быстро работали над обновлениями.

Но к тому лету г-н Суцкевер все больше убеждался в том, что ученые-компьютерщики находятся на грани разработки общего искусственного интеллекта (AGI) — точки, в которой машины будут соответствовать человеческому интеллекту, — согласно книге журналистки Карен Хао.

На встрече г-н Суцкевер предложил коллегам вырыть подземное убежище для ведущих ученых компании, прежде чем такая мощная технология будет выпущена в свет, сообщает г-жа Хао.

AFP через Getty Images

AFP через Getty Images«Мы обязательно построим бункер, прежде чем выпустить AGI», — широко сообщается, что он сказал, хотя неясно, кого он имел в виду под «мы».

Это проливает свет на странный факт: многие ведущие ученые-компьютерщики и технологические лидеры, некоторые из которых усердно работают над разработкой чрезвычайно умной формы ИИ, также, похоже, глубоко боятся того, что он может однажды сделать.

Так когда же именно появится AGI, если вообще когда-нибудь появится? И действительно ли это может оказаться достаточно преобразующим, чтобы напугать обычных людей?

Прибытие «раньше, чем мы думаем»

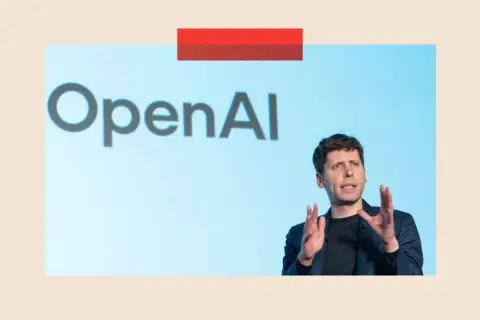

Лидеры технологий заявляют, что AGI неизбежен. Глава OpenAI Сэм Альтман заявил в декабре 2024 года, что это произойдет «раньше, чем думает большинство людей в мире».

Сэр Демис Хассабис, соучредитель DeepMind, предсказал, что это произойдет в ближайшие пять-десять лет, а основатель Anthropic Дарио Амодей написал в прошлом году, что его любимый термин — «мощный ИИ» — может появиться у нас уже в 2026 году.

Другие сомневаются. «Они постоянно перемещают стойки ворот», — говорит Дама Венди Холл, профессор информатики в Саутгемптонском университете. «Это зависит от того, с кем ты разговариваешь». Мы разговариваем по телефону, но я почти слышу, как закатываются глаза.

«Научное сообщество говорит, что технология искусственного интеллекта удивительна, — добавляет она, — но она далека от человеческого интеллекта».

Сначала необходимо совершить ряд «фундаментальных прорывов», соглашается Бабак Ходжат, технический директор технологической компании Cowlant.

Более того, вряд ли это произойдет в один момент. Скорее, ИИ — это быстро развивающаяся технология, она находится в пути, и многие компании по всему миру стремятся разработать свои собственные версии.

Но одна из причин, по которой эта идея волнует некоторых в Кремниевой долине, заключается в том, что она считается предшественником чего-то еще более продвинутого: ИСИ, или искусственного суперинтеллекта – технологии, превосходящей человеческий интеллект.

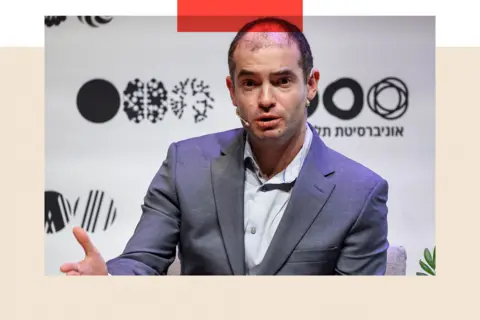

Еще в 1958 году понятие «сингулярность» было посмертно приписано уроженцам Венгрии. математик Джон фон Нейман. Это относится к моменту, когда компьютерный интеллект выйдет за рамки человеческого понимания.

Гетти Изображения

Гетти ИзображенияСовсем недавно в вышедшей в 2024 году книге «Генезис», написанной Эриком Шмидтом, Крейгом Манди и покойным Генри Киссинджером, исследуется идея сверхмощной технологии, которая становится настолько эффективной в принятии решений и лидерстве, что в конечном итоге мы полностью передаем ей контроль.

Это вопрос того, когда, а не если, спорят они.

Деньги для всех, не нуждаясь в работе?

Те, кто поддерживает AGI и ASI, почти евангелисты в отношении их преимуществ. Они утверждают, что оно найдет новые лекарства от смертельных болезней, решит проблему изменения климата и изобретет неисчерпаемый запас чистой энергии.

Илон Маск даже заявил, что сверхразумный ИИ может открыть эру «всеобщего высокого дохода».

Недавно он поддержал идею о том, что ИИ станет настолько дешевым и широко распространенным, что практически каждый захочет иметь «свои личные R2-D2 и C-3PO» (имея в виду дроидов из «Звездных войн»).

«Каждый будет иметь лучшее медицинское обслуживание, еду, домашний транспорт и все остальное. Устойчивое изобилие», – с энтузиазмом заявил он.

Конечно, есть и страшная сторона. Могут ли технологии быть захвачены террористами и использованы в качестве огромного оружия, или что, если они сами решат, что человечество является причиной мировых проблем и уничтожит нас?

AFP через Getty Images

AFP через Getty Images«Если он умнее вас, то мы должны сдерживать его», — предупредил Тим Бернерс Ли, создатель Всемирной паутины, в разговоре с BBC в начале этого месяца.

«Мы должны иметь возможность выключить его».

Правительства принимают некоторые защитные меры. В США, где базируются многие ведущие компании в области искусственного интеллекта, президент Байден в 2023 году издал указ, который требовал от некоторых фирм делиться результатами испытаний на безопасность с федеральным правительством, хотя президент Трамп с тех пор отменил некоторые из указов, назвав их «барьером» для инноваций.

Тем временем в Великобритании два года назад был создан Институт безопасности ИИ — финансируемый государством исследовательский орган, чтобы лучше понять риски, связанные с передовым ИИ.

А еще есть сверхбогатые люди со своими собственными планами страхования от апокалипсиса.

Гетти Изображения

Гетти Изображения«Сказать, что вы «покупаете дом в Новой Зеландии», — это своего рода подмигивание, не сказать больше», — сказал ранее Рид Хоффман. То же самое, по-видимому, касается и бункеров.

Но есть явно человеческий недостаток.

Однажды я встретил бывшего телохранителя одного миллиардера, у которого был собственный «бункер», который сказал мне, что первоочередной задачей его службы безопасности, если бы это действительно произошло, было бы устранить указанного босса и самим проникнуть в бункер. И он, похоже, не шутил.

Это все паникерская чушь?

Нил Лоуренс — профессор машинного обучения в Кембриджском университете. По его мнению, вся эта дискуссия сама по себе является ерундой.

«Идея общего искусственного интеллекта столь же абсурдна, как и идея «искусственного общего транспортного средства», — утверждает он.

«Подходящий автомобиль зависит от контекста. Я использовал Airbus A350, чтобы полететь в Кению, я использую машину, чтобы каждый день добираться до университета, я хожу в столовую… Не существует транспортного средства, которое когда-либо могло бы сделать все это».

Для него разговоры об AGI — это отвлечение.

«Технологии, которые у нас есть [already] build впервые позволяет обычным людям напрямую общаться с машиной и потенциально заставлять ее делать то, что они задумали. Это совершенно необычно… и совершенно преобразующе.

«Большое беспокойство вызывает то, что мы настолько увлечены рассказами крупных технологических компаний об AGI, что упускаем из виду способы улучшения жизни людей».

Гетти Изображения

Гетти ИзображенияСовременные инструменты искусственного интеллекта обучены на горах данных и хорошо распознают закономерности: будь то признаки опухоли на сканах или слово, которое с наибольшей вероятностью будет следовать за другим в определенной последовательности. Но они не «чувствуют», какими бы убедительными ни казались их ответы.

«Есть несколько «хитрых» способов заставить большую языковую модель (основа чат-ботов с искусственным интеллектом) действовать так, как будто она обладает памятью и обучается, но они неудовлетворительны и значительно уступают людям», — говорит г-н Ходжат.

Винс Линч, генеральный директор калифорнийской компании IV.AI, также опасается преувеличенных заявлений об AGI.

«Это отличный маркетинг», — говорит он. — «Если вы — компания, создающая самую умную вещь из когда-либо существовавших, люди захотят дать вам деньги».

Он добавляет: «Это не дело двух лет. Это требует столько вычислений, столько человеческого творчества, столько проб и ошибок».

Гетти Изображения

Гетти ИзображенияНа вопрос, верит ли он, что AGI когда-нибудь материализуется, последовала долгая пауза.

«Я действительно не знаю».

Разум без сознания

В некотором смысле ИИ уже опередил человеческий мозг. Инструмент генеративного искусственного интеллекта может в одну минуту стать экспертом по средневековой истории, а в следующую — решать сложные математические уравнения.

Некоторые технологические компании говорят, что не всегда знают, почему их продукты реагируют именно так. В Meta говорят, что есть некоторые признаки улучшения ее систем искусственного интеллекта.

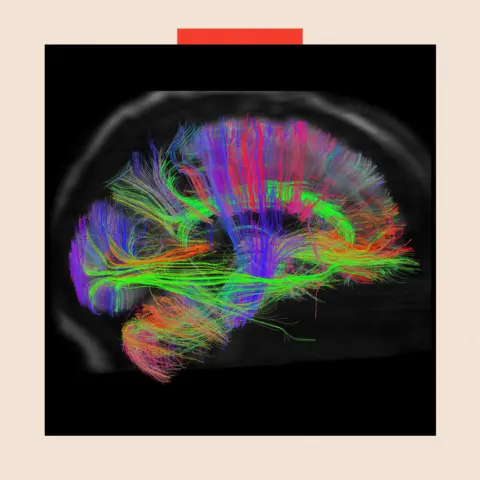

Однако в конечном итоге, какими бы умными ни стали машины, биологически человеческий мозг все равно побеждает. У него около 86 миллиардов нейронов и 600 триллионов синапсов, что намного больше, чем у искусственных эквивалентов.

Мозгу также не нужно делать паузу между взаимодействиями, и он постоянно адаптируется к новой информации.

«Если вы скажете человеку, что на экзопланете была обнаружена жизнь, он немедленно узнает об этом, и это повлияет на его мировоззрение в будущем. [Large Language Model]они будут знать это только до тех пор, пока вы будете повторять им это как факт», – говорит г-н Ходжат.

«У LLM также нет мета-познания, а это означает, что они не совсем знают то, что знают. интроспективная способность, иногда называемое сознанием, которое позволяет им знать то, что они знают».

Это фундаментальная часть человеческого интеллекта, и ее еще предстоит воспроизвести в лаборатории.

Авторы лучших изображений: The Washington Post через Getty Images/Getty Images MASTER. На главном изображении изображен Марк Цукерберг и стоковое изображение бункера в неизвестном месте.

BBC: Подробности это место на веб-сайте и в приложении для лучшего анализа, где представлены свежие взгляды, бросающие вызов предположениям, и подробные отчеты по самым важным проблемам современности. А еще мы демонстрируем заставляющий задуматься контент из BBC Sounds и iPlayer. Вы можете подписаться на уведомления, которые будут предупреждать вас о публикации статьи BBC InDepth — узнайте как здесь зарегистрироваться.